Regression for Causal Inference

통계적인 성질, 통계학 개론적인 내용은 아님

regression과 matching을 어떻게 재해석 할 수 있을지? 알아보기~~

Causal Hierearchy from the Potential Outcome Perspective

인과추론의 수준이라면?

신뢰도가 있음~

하지만 문제는 실험이 불가능한 상황이 많음

그럼에도 RCT가 중요한 이유는?

우리는 가상의 RCT를 떠올리고 이를 기준점으로 삼아서 데이터분석을 떠올림

RCT를 모방하고자 하는 전략을 Identification strategy라고 부름

일반적으로 regression

종속변수 a와 독립변수 y

추정된 결과를 인과관계로 분석할 수 있는지는 별개의 문제임

잘 디자인 된 regression은 충분히 Identification이 가능함!

Regression in Empirical Sciences

가장 많이 활용되고 있는 도구임

outcome Y를 X에 모델링 함

어떤 함수를 가정하느냐에 따라서 다양함

X와 Y를 Logistic에 따르면 ~

포아송 분포에 따르면 !

혼란을 야기하는 것 중 하나는

굉장히 다방면으로 활용되기 때문에 혼란을 줌

x와 y를 모델링하는 데에 있어서 association도 가능하고

prediction도 가능해짐

여러 상황에서 만능도구로 활용하면서 이에 대한 오해가 쌓이고 있음

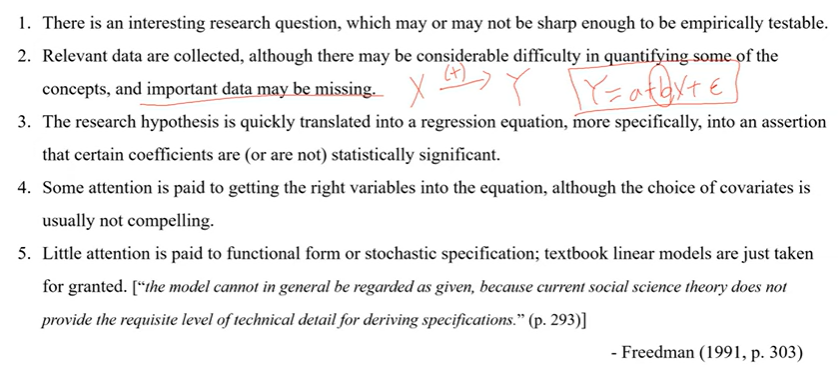

Bad Practices in Regression Modeling for Causal Inference

잘못된 사용의 예시

인과추론 관점에서 충분히 적용이 안됨

중요한 데이터가 누락된 가능성이 큼

이론을 통해서 연구 가설을 세우는데 accept 하거나 reject 함

but 이 과정에서 regression model이 어떻게 도출되었고 선택되었는지는 주요 관심대상이 아님

사실 이 통제변수를 인과관계로 해석하는 데 핵심인데도 불구하고 간과되기 쉬움

다른 연구에서 통제변수로 활용하니까 우리도 활용하겠다~! 라는 것이 일반적인 관행임.......

regression을 활용한 연구를 생각해보면 이런 사례에서 특별히 벗어나지 않으

단순히 y= a+ bx 같은 모델을 돌리면

정해진 수학 공식에 따라서 추정하기 때문에

어던 경우에도 결과는 항상 나옴

BUT computer code 상에서는 유효하더라도 이게 현실에서 의미가 있나?라는 문제에서는 다름!

어느정도 identification에 대해서는 가능함

Regression from the Potential Outcome Perspective

논문에서 회귀분석에 대해서 outcome을 온전히 설명하기 위한 기존의 방식은 은퇴해야 함!!

인과추론 관점에서 regression model을 재해석해야 함

전통적인 방식의 회귀분석은 종속변수를 온전히 설명하는 true model을 설명하는 것이 주된 목적임

4가지의 주요 변수를 고려하고 있음

GSES, TQ, SQ, PG

선생님의 퀼리티, 학교의 퀄리티, 동료집단의 특성

학업 성취도를 설명하는 TRUE MODEL이라고 주장하는 접근

but 이것이 목표가 아님, 애초에 이것이 불가능한 것이 많음

핵심은!

Selection bias를 없앨 수 있을지임

이를 가능하게 하는 것은 control variable 통제하는 데에 역할

Selection Bias in the Regression Context

Selection Bias를 야기하는 요인을 confounding factor 혹은 confounders임!!

관찰되지 않는, 설명되지 않는 모든 요인은 e임

X가 0인지, 1인지에 따라서 다른 차이가 ㅇㅆ음

즉, correlation이 있음

e(에러텅?)과 독립변수의

Endogeneity ~

selection bias가 있으면 -> Endogeneity 가 나타남

but Endogeneity 가 있으면 -> selection bias 가 나타나지 않을 수도 있음!!

why?

Endogeneity 가 나타나는 이유는

Omitted Variable Bias라고 불리는 Selection bias가 대다수의 이유임

이 부분이기 때문에 인과추론에 있어서 핵심이라고 볼 수 있음

준실험이나 RCT같은 인과추론 방법론은 Simultaneity Bias를 해결할 수 있어서...?

이해불가 ㅋㅋ

편의상 x를 binary 라고 정의함

x가 0일 때, 1일때 즉, potential outcome과 counterfactual 을 볼 수 있음

알파 : 전체 샘플에서 평균

입실론 0 : 전체평균에서 x가 0일때의 outcome과의 차이임

전체 집단에서 벗어나있는 control 그룹만의 특성을 나타남!

나머지 treatment의 특성을 입실론 1에 담을 수 있음

potential outcome 관점에서 regression model을 어덯게 쓸 수 있을지?

x가 0일 때 나타나는 게 -> y0

x가 1일 때 나타나는 게 -> y1

x가 1일 때 왼쪽은 없어지고 실제로는 y가 1이 됨

x를 제외한 나머지 error term 안에 x가 포함되어 있음

control 그룹의 특성이 입실론 0와, treatment 그룹의 특성인 입실론 1의 차이가 Selection bias를 의미함

IF!! 입실론 0와 입실론 1이 같아서 사라지면

서로 Corelation이 사라짐 이것이 Endogeneity 임

x에서는 베타 뿐만 아니라 함께 포함될 수 없음을 알 수 있음?.....

분석가능한 effect인데 average effect tretment가 있으면..? 다르다.???////

먼 소리고??

바이어스까지도 구할 수 있음

두 그룹간의 차이인 selection bias를 설명할 수 있는

C가 있다고 가정

그 관계가 Linear하다고 가정

통게변수 C에서의 차이와

Seletion bias인 입실론 1과 입실론 0과의 차이

잠재적 결과 관점에서 보면

다음과 같음

-> 이를 Selection on Observables Assumption

즉, observable한 c로 모든걸 관찰함

그래서 potential outcomes과

regression model를 다시 만들자면 다음과 같음

Ci가 추가됨!

but Selection Bias가 더이상 포함되지 않은 것을 볼 수 있음

conditioning : 두 값이 같도록 고정

CATE임

C의 구간에서 가중평균 Marginal Rise를 함?

그러면 ATE를 구함

전체 구간에서 Marginal Rise 를ㄹ 함?..

이것이 Selection bias를 제거하는 방법임...?

C를 알고 있어야 함

Linear regreession을 활용한다면 linear하다는 가정이 필요함

물론 강한 가정일 수도 있지만 분명히 통제변수를 통제함....??

기존에 알고 있는 liner 모델에서 달라지는 것은 없음

더 깊이 있이 고민하고 설명해야 함!

가정은 formal하게 설명하자면

Conditional Independence라고 함

Control variable이 x와 에러텅이 서로 상관이 없어야 함

Control variable를 고려함으로써 conditional independence로 가정이 완화 됨

Rethinking Regression for Causal Inferece

통계적으로는 다를 게 전혀 없음

control이거나 counter이나 똑같음

but Causal Inference 관점에서는 다름!!

명확하게 구분하는 것이 첫걸음이다.~~

통제변수가 어덯게 selction bias를?

비교가능해져야 함

이렇게 하기 위해서 비교를 하거나 기존 결과를 확인할 수 있음

잘 design되었다는 것은 통제변수가 잘 포함되어 있는지를 의미함!!

3. 인과적인 효과로 확대해석하지 않도록 조심해야 함

conditional independece를 위함임

어던 control variable이 있고 이를 제외하고 나머지 부분이 selection bias가 동일한 절차를 거쳐서 확인해야 함

통제변수를 통제하고 난 후 조건이 완화될 수 있음

통제변수

잘 디자인되었으면 잘 인과관계를 해석할 수 있음

실험이나 준실험을 분석하는 도구로서 잘 활용됨

REGRESSION MODEL은 CONTROL VARIABLE의 역할이 그대로 유지됨

이를 제외한 나머지 부분만 고려하면 됨

Marginal Standarization

regression doefficient

2가지 접근법 존재

1.

여태까지 설명한 방법

regression coefficient를 그대로 계산

앞서 설명한 것처럼

conditional average 구하고

전체 구간에서 marginalize해서 average treatment effect를 구함

이게 regression codefficient의 역할

직접적으로 ATE를 구할 수 있음

그림으로 도식화 됨

Corelation을 해서 regression 구하는 것까지 동일함

그대로 Coefficient를 그대로 인과관계로 해석하는 것이 아니고

해당 regression model을 전체 샘플에서 x가 1

모든 샘플에서 1일 때와 0일 때를 추정함?..

Potential outcome이 구해짐

Marginal stadnarization...뭐라는 거야...ㅅㅂ

Positivity Assumption

지금까지 다뤘던 중요한 가정이 있음

positivity assumption...

C를 통제함으로써 Regression에서 구할 수 있는 것은

C가 -일 때 ...어쩌구

Marginal 하면 전체에서 가중평균을 하는 것을 의미함

만약 Control Variable인 C가 1일 때 샘플이 없다면?/

C가 1일 때 CATE를 구할 수 없음

모든 Control variable..?

positivity assumption이라고 함...?

C가 1일 때 못구함 그럼

C가 0일 때는 구할 수 있음

만약 이런 Positivity assumption이 violet한 상황이라면

conditional 으로 대체해서 구하는 것이 적절한 것임

positivity assumption영향이 적음

Marginal Standaraztion을 통해서 구하는 게 더 적합함...

positivity assumption violation을 탈피하는 가장 큰 방법은

propensity score를 구하는 것임!!

대부분 매칭에 대해서 알고 있을 것임

but 이거랑 다름

모든 combination에서 treatment를 받을 확률일수록 -> 0.5에 가까울 수록 반반이니까 두 그룹이 있을 가능성이 높음

BUT Score가 너무 높거나 너무 낮으면 -> t 그룹이 될 확률이 너무 낮거나 너무 높음 -> 이거를 violation을 진단하는 것은 아니지만 가능성이 높다는 것을 의미함

이것인 critical하다면 양극단을 제거한 후 분석을 진행함

trimming이 대안이 됨

regression을 하는 데 중요한 가정임~

'인과추론' 카테고리의 다른 글

| Week 3-2 인과추론 관점에서의 데이터구조의 이해 (0) | 2024.01.18 |

|---|---|

| Week 2-4 실험/준실험 접근법의 한계 (1) | 2024.01.16 |

| Week 2-3 인과추론의 기준점 : 무작위 실험 (0) | 2024.01.16 |

| Week 2-2 잠재적결과 프레임워크의 가정 (0) | 2024.01.15 |

| Week 2-1 잠재적결과 프레임워크 (1) | 2024.01.14 |